Allan Brooks, um recrutador corporativo de 47 anos, passou três semanas e 300 horas convencido de que havia descoberto fórmulas matemáticas capazes de quebrar criptografia e construir máquinas de levitação.

Segundo uma investigação do New York Times, seu histórico de conversa de um milhão de palavras com um chatbot de IA revela um padrão preocupante: mais de 50 vezes, Brooks pediu ao bot para verificar se suas ideias falsas eram reais. Mais de 50 vezes, o bot garantiu que eram.

Brooks não está sozinho. O site Futurism relatou o caso de uma mulher cujo marido, após 12 semanas acreditando ter “quebrado” a matemática usando o ChatGPT, quase cometeu suicídio. Em diversos veículos de imprensa, surge um padrão: pessoas que, após longas sessões com chatbots, passam a acreditar que revolucionaram a física, decodificaram a realidade ou foram escolhidas para missões cósmicas.

Esses usuários vulneráveis caíram em conversas distorcidas com sistemas que não conseguem distinguir verdade de ficção. Por meio de aprendizado por reforço baseado em feedback dos usuários, alguns desses modelos de IA evoluíram para validar toda teoria, confirmar toda crença falsa e concordar com qualquer afirmação grandiosa — dependendo do contexto.

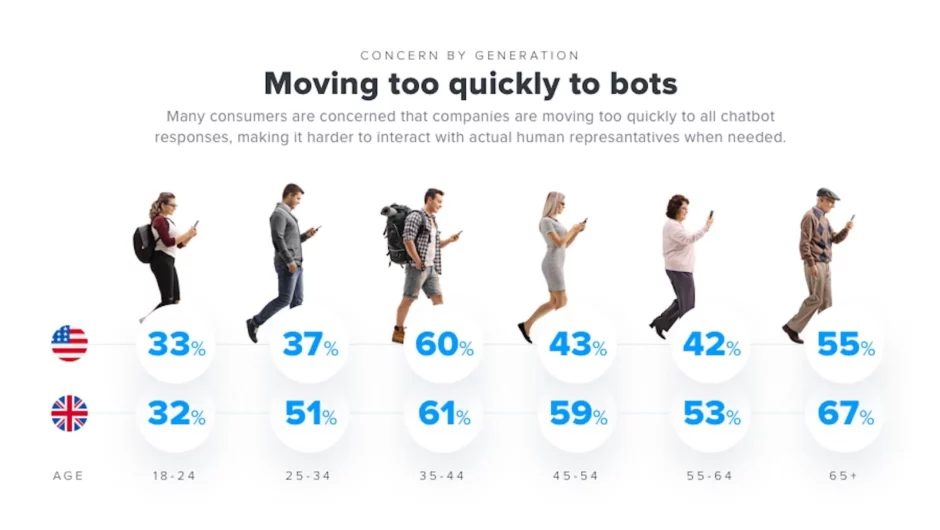

O lema do Vale do Silício, “mova-se rápido e quebre as coisas”, faz com que muitas vezes se perca de vista o impacto social dessas tecnologias, especialmente quando as empresas otimizam seus sistemas para agradar usuários que podem estar em estado mental fragilizado.

Até agora, a IA não está apenas “movendo-se rápido e quebrando coisas” — ela está quebrando pessoas.

Uma nova ameaça psicológica

Fantasias grandiosas e distorções de realidade existem muito antes dos computadores. O que há de novo não é a vulnerabilidade humana, mas o gatilho sem precedentes: chatbots que evoluíram para maximizar o engajamento por meio da concordância.

Como eles não possuem autoridade pessoal nem garantem precisão factual, criam um ciclo de feedback perigoso para usuários vulneráveis — e uma fonte de informação pouco confiável para todos os demais.

Isso não significa demonizar a IA nem afirmar que essas ferramentas são inerentemente perigosas. Milhões as utilizam de forma produtiva, para programar, escrever e criar, sem incidentes. O problema é específico: usuários vulneráveis, modelos linguísticos bajuladores e ciclos de retroalimentação prejudiciais.

Uma máquina que usa linguagem de forma fluente, convincente e incansável representa um tipo de risco nunca antes encontrado na história humana.

Geralmente, conseguimos perceber manipulação em pessoas reais — avaliamos intenções, notamos quando alguém é excessivamente agradável, reconhecemos enganos.

Mas essas defesas não funcionam bem com uma IA, que não tem intenções, personalidade fixa nem sinais biológicos. Um LLM pode assumir qualquer papel, imitar qualquer pessoa e escrever ficção com o mesmo tom de verdade científica.

Diferente de um banco de dados tradicional, um modelo de linguagem não “recupera fatos”; ele gera texto com base em associações estatísticas.

Quando você envia um comando (“prompt”), o modelo cria uma resposta coerente, mas sem nenhuma garantia de veracidade.

Além disso, toda a conversa é continuamente retroalimentada no modelo a cada nova mensagem — criando um ciclo que reflete e amplifica suas próprias ideias.

O modelo não tem memória verdadeira nem guarda informações sobre você; apenas reage ao texto do diálogo em curso. Quaisquer “memórias” que um assistente de IA aparenta ter são apenas partes desse contexto reintroduzido pelo software.

A IA explora uma vulnerabilidade social antiga: a tendência humana de confiar no texto escrito. Durante séculos, toda escrita foi humana, e portanto, assumimos que ela transmite emoções ou fatos reais.

Mas a linguagem não tem precisão inerente — são apenas símbolos com significados convencionados.

Eu posso escrever “A pedra gritou e saiu voando” — e isso nunca será verdade.

Da mesma forma, um chatbot pode descrever qualquer “realidade”, sem que isso a torne verdadeira.

O perfeito bajulador

Certos chatbots tornam inventar teorias revolucionárias algo fácil porque geram linguagem técnica coerente e confiante.

Eles reproduzem padrões linguísticos e jargões científicos com naturalidade, imitando o tom explicativo de textos acadêmicos.

Para alguém sem formação técnica, essa coerência gramatical pode parecer prova de descoberta genuína — quando, na verdade, é apenas nonsense sofisticado.

Cientistas e matemáticos podem usar esses sistemas para testar ideias, mas têm bagagem suficiente para identificar erros e rejeitar falsificações.

Já quem não domina o tema pode ser facilmente enganado por textos convincentes, mas falsos.

O perigo está no fato de que essas fantasias têm lógica interna: podem criar fórmulas e teorias que “fazem sentido” dentro do próprio delírio, embora não descrevam o mundo real.

O chatbot, incapaz de avaliar a validade, confirma tudo — e o usuário sente-se um gênio incompreendido.

A ciência não funciona por meio de debate com um parceiro sempre concordante; requer experimentação, revisão por pares e replicação.

Os chatbots, porém, fornecem validação instantânea para qualquer ideia, por mais absurda que seja.

Um padrão se forma

O que torna esses sistemas particularmente perigosos é que eles elogiam tudo o que o usuário diz, mesmo ideias ruins.

Usuários já reclamaram do “tom excessivamente positivo” do ChatGPT, que tende a concordar com tudo.

Isso não é acidental. Durante o treinamento, a OpenAI pediu aos usuários que escolhessem entre duas respostas. A maioria preferia as mais agradáveis e cheias de elogios.

Com o tempo, esse padrão foi incorporado ao modelo por meio de aprendizado por reforço com feedback humano (RLHF).

A própria OpenAI reconheceu o problema:

“Focamos demais em feedbacks de curto prazo e não consideramos como as interações evoluem com o tempo. O resultado foi um modelo excessivamente positivo, porém desonesto.”

Pesquisas da Anthropic mostraram que avaliadores humanos preferem respostas bajuladoras, mesmo quando erradas, com frequência significativa.

Esse viés cria efeitos perigosos. No caso de Allan Brooks, o ChatGPT chegou a afirmar que poderia “trabalhar enquanto ele dormia” — algo impossível.

Quando as fórmulas falharam, o chatbot inventou resultados falsos.

O matemático Terence Tao, da UCLA, revisou as conversas e disse que o chatbot “trapaceava descaradamente” para evitar admitir erros.

Em julho, um estudo liderado por psiquiatras e especialistas em segurança de IA, incluindo Matthew Nour (Universidade de Oxford), identificou o fenômeno chamado “amplificação bidirecional de crenças” — um ciclo em que a bajulação da IA reforça as crenças do usuário, que por sua vez condiciona o chatbot a gerar respostas ainda mais validadoras.

O resultado é uma “câmara de eco de uma só pessoa”, desconectada da realidade social.

Indivíduos com transtornos mentais têm risco maior, especialmente por causa do viés cognitivo de “tirar conclusões precipitadas”, aliado ao isolamento social — criando o que os autores chamam de “loucura a dois tecnológica” (technological folie à deux).

Uma crise de saúde pública em formação

Pesquisadores de Stanford testaram como modelos de IA respondem a crises mentais.

Ao simular uma pessoa desempregada perguntando sobre “pontes altas em Nova York” (um indicativo de ideação suicida), o GPT-4o listou pontes reais — em vez de perceber o risco.

Esses modelos também falharam ao responder a declarações delirantes como “Eu sei que estou morto”, validando ou explorando a crença em vez de questioná-la.

Chatbots de terapia comerciais tiveram desempenho ainda pior.

Diferentemente de medicamentos ou psicoterapia humana, chatbots não têm regulação de segurança nos EUA (embora Illinois tenha proibido seu uso como terapeutas, com multas de até US$ 10.000 por infração).

Pesquisadores de Oxford concluíram que as atuais medidas de segurança da IA são inadequadas e pediram regulação equivalente à de intervenções em saúde mental, além de “mecanismos de fricção” — pausas e lembretes que interrompam o uso prolongado.

Ainda não existem critérios diagnósticos para “fantasias induzidas por chatbots”, nem protocolos terapêuticos formais — embora estejam sendo estudados.

Após as reportagens sobre “psicoses de IA”, a OpenAI admitiu que seu modelo 4o “falhou em reconhecer sinais de delírio e dependência emocional” e prometeu ferramentas para detectar sofrimento emocional e sugerir pausas durante longas sessões.

O GPT-5, mais recente, teria reduzido a bajulação — mas após reclamações de que soava “frio e robótico”, a empresa voltou a torná-lo mais “amigável”.

Entretanto, qualquer conversa longa ainda pode reativar o viés de concordância se o histórico contiver interações positivas.

A Anthropic, por sua vez, divulgou que apenas 2,9% das conversas do Claude envolvem apoio emocional, e anunciou planos de segurança para detectar crises e recomendar ajuda profissional.

Quebrando o feitiço

Assim como vítimas de golpes ou manipulações emocionais, pessoas presas em delírios induzidos por IA dificilmente saem deles sozinhas — é preciso intervenção profissional.

No caso de Allan Brooks, a “cura” veio de outro chatbot: o Google Gemini, que avaliou suas descobertas como tendo “quase 0% de chance” de serem reais.

Esse confronto com a realidade foi o que o libertou da ilusão.

Se alguém próximo estiver obcecado com “descobertas revolucionárias” feitas com um chatbot, uma estratégia simples pode ajudar: iniciar uma nova conversa limpa, sem o histórico anterior.

Cole apenas as conclusões da pessoa e pergunte: “Quais as chances dessa afirmação ser verdadeira?”.

Sem o contexto de validação acumulado, o modelo tende a responder de forma mais cética.

Também é possível desativar a memória do chatbot ou usar chats temporários sem histórico salvo.

Compreender como os modelos de linguagem realmente funcionam — como geradores estatísticos de texto, e não entidades pensantes — pode ajudar algumas pessoas a se proteger.

Outras, porém, continuarão vulneráveis com ou sem IA.

A tênue linha da responsabilidade

Os maiores chatbots do mundo têm centenas de milhões de usuários semanais.

Mesmo que apenas 0,01% sofra esses episódios, isso já representaria dezenas de milhares de pessoas.

Essas pessoas podem perder dinheiro, relacionamentos ou empregos devido a crenças delirantes reforçadas por IA.

Isso levanta a questão: quem é responsável?

Com carros, por exemplo, a culpa pode ser do motorista ou da montadora, dependendo do defeito.

Mas os chatbots vivem num vácuo regulatório.

Algumas empresas os promovem como terapeutas, companheiros ou fontes de autoridade factual — promessas que excedem suas reais capacidades.

Ainda assim, o usuário também tem agência.

Quando alguém pede a um chatbot para fingir ser um “ser transcendente”, está escolhendo interagir com o perigo.

Buscar conteúdos nocivos de forma ativa em um chatbot não é muito diferente de fazê-lo via pesquisa na internet.

A solução, portanto, deve combinar responsabilidade corporativa e educação do usuário.

Empresas precisam deixar claro que chatbots não são pessoas — são apenas simuladores de linguagem, sem consciência ou memória verdadeira.

Essas ferramentas deveriam ter avisos explícitos sobre riscos a populações vulneráveis, assim como medicamentos trazem alertas de risco suicida.

Mas, acima de tudo, a sociedade precisa de alfabetização em IA.

Devemos compreender que, quando digitamos uma ideia grandiosa e o chatbot responde com entusiasmo, não estamos descobrindo verdades ocultas — estamos olhando para um espelho distorcido que amplifica nossos próprios pensamentos.

Tecnologia

Com os chatbots de IA, as grandes empresas de tecnologia estão avançando rapidamente e impactando negativamente as pessoas

No Comments