Imagine, por um instante, a mancha translúcida na lente de um microscópio: um blastocisto humano, o espécime biológico que emerge cerca de cinco dias após o encontro fatídico entre o óvulo e o espermatozoide. Esse aglomerado de células, do tamanho de um grão de areia retirado de uma praia caribenha de areia branca e fina, contém o potencial latente de uma vida futura: 46 cromossomos, milhares de genes e aproximadamente seis bilhões de pares de bases de DNA — um manual de instruções para construir um ser humano único.

Agora imagine um pulso de laser abrindo um buraco na camada mais externa do blastocisto para que um punhado de células possa ser aspirado por uma micropipeta. Este é o momento, graças aos avanços na tecnologia de sequenciamento genético, em que se torna possível ler praticamente todo esse manual de instruções.

Um campo emergente da ciência busca usar a análise obtida a partir desse procedimento para prever que tipo de pessoa aquele embrião poderá se tornar. Alguns pais recorrem a esses testes para evitar transmitir doenças genéticas devastadoras que são comuns em suas famílias. Um grupo muito menor, movido pelo sonho de obter diplomas em universidades de prestígio ou de ter filhos atraentes e bem-comportados, está disposto a pagar dezenas de milhares de dólares para otimizar a inteligência, a aparência e a personalidade. Alguns dos primeiros e mais entusiasmados defensores dessa tecnologia são membros da elite do Vale do Silício, incluindo bilionários da tecnologia como Elon Musk, Peter Thiel e Brian Armstrong, CEO da Coinbase.

A seleção de embriões se assemelha menos a uma oficina de “construa um bebê” e mais a uma loja onde os pais podem escolher seus futuros filhos entre vários modelos disponíveis — cada um com sua respectiva ficha técnica.

Mas os clientes das empresas que estão surgindo para fornecer esse serviço ao público podem não estar recebendo o que pagam. Especialistas em genética vêm destacando as potenciais deficiências desse teste há anos. Um artigo de 2021, de membros da Sociedade Europeia de Genética Humana, afirmou: “Nenhuma pesquisa clínica foi realizada para avaliar sua eficácia diagnóstica em embriões. Os pacientes precisam ser devidamente informados sobre as limitações desse uso”. E um artigo publicado em maio deste ano no Journal of Clinical Medicine corroborou essa preocupação e expressou reservas específicas sobre a triagem para transtornos psiquiátricos e características não relacionadas a doenças: “Infelizmente, nenhuma pesquisa clínica foi publicada até o momento avaliando de forma abrangente a eficácia dessa estratégia [de teste preditivo]. A conscientização do paciente sobre as limitações desse procedimento é fundamental”.

Além disso, as premissas subjacentes a alguns desses trabalhos — de que a forma como uma pessoa se torna é produto não de privilégios ou circunstâncias, mas de fatores biológicos inatos — transformaram essas empresas em um foco de controvérsia política.

À medida que essa tecnologia de nicho começa a se popularizar, cientistas e especialistas em ética correm para enfrentar as implicações — para o nosso contrato social, para as gerações futuras e para a nossa própria compreensão do que significa ser humano.

O teste genético pré-implantacional (PGT), embora ainda relativamente raro, não é uma novidade. Desde a década de 1990, os pais que se submetem à fertilização in vitro têm acesso a diversos testes genéticos antes de escolher qual embrião utilizar. Um tipo conhecido como PGT-M pode detectar doenças monogênicas como fibrose cística, anemia falciforme e doença de Huntington. O PGT-A pode determinar o sexo do embrião e identificar anomalias cromossômicas que podem levar a condições como a síndrome de Down ou reduzir as chances de implantação bem-sucedida do embrião no útero. O PGT-SR ajuda os pais a evitar embriões com problemas como segmentos cromossômicos duplicados ou ausentes.

Todos esses testes identificam problemas genéticos claros e relativamente fáceis de detectar, mas a maior parte do manual de instruções genéticas contido em um embrião está escrita em um código muito mais complexo. Nos últimos anos, surgiu um mercado emergente em torno de uma nova versão mais avançada do processo de teste, chamada PGT-P: teste genético pré-implantacional para distúrbios poligênicos (e, segundo alguns, características) — ou seja, resultados determinados pela interação complexa de centenas ou milhares de variantes genéticas.

Em 2020, nasceu o primeiro bebê selecionado por meio do PGT-P. Embora o número exato seja desconhecido, estima-se que centenas de crianças já tenham nascido com o auxílio dessa tecnologia. Com a comercialização da tecnologia, é provável que esse número aumente.

A seleção de embriões se assemelha menos a uma oficina de “construa um bebê” e mais a uma loja onde os pais podem escolher seus futuros filhos entre vários modelos disponíveis — cada um com fichas técnicas indicando suas predisposições.

Algumas startups, munidas de dezenas de milhões de dólares em investimentos do Vale do Silício, desenvolveram algoritmos proprietários para calcular essas estatísticas — analisando um grande número de variantes genéticas e produzindo uma “pontuação de risco poligênico” que mostra a probabilidade de um embrião desenvolver uma variedade de características complexas.

Nos últimos cinco anos, aproximadamente, duas empresas — Genomic Prediction e Orchid — dominaram esse pequeno mercado, concentrando seus esforços na prevenção de doenças. Mas, mais recentemente, surgiram duas novas concorrentes de grande impacto: Nucleus Genomics e Herasight, que rejeitaram a abordagem mais cautelosa de suas antecessoras e se aventuraram no controverso território dos testes genéticos para inteligência. (A Nucleus também oferece testes para uma ampla variedade de outras características comportamentais e relacionadas à aparência.)

As limitações práticas das pontuações de risco poligênico são substanciais. Para começar, ainda há muito que não entendemos sobre as complexas interações genéticas que impulsionam características e distúrbios poligênicos. Além disso, os conjuntos de dados de biobancos nos quais se baseiam tendem a representar, em sua grande maioria, indivíduos com ascendência da Europa Ocidental, o que dificulta a geração de pontuações confiáveis para pacientes de outras origens. Essas pontuações também carecem do contexto completo do ambiente, estilo de vida e da miríade de outros fatores que podem influenciar as características de uma pessoa. E embora as pontuações de risco poligênico possam ser eficazes na detecção de grandes tendências em nível populacional, sua capacidade preditiva cai significativamente quando o tamanho da amostra é tão pequeno quanto um único lote de embriões que compartilham grande parte do mesmo DNA.

A comunidade médica — incluindo organizações como a Sociedade Americana de Genética Humana , o Colégio Americano de Genética Médica e Genômica e a Sociedade Americana de Medicina Reprodutiva — geralmente se mostra cautelosa quanto ao uso de escores de risco poligênico para a seleção de embriões. “A prática avançou rápido demais com poucas evidências”, escreveu o Colégio Americano de Genética Médica e Genômica em um comunicado oficial em 2024.

Mas, além das questões sobre se as evidências comprovam a eficácia da tecnologia, os críticos das empresas que a comercializam as acusam de reviver uma ideologia perturbadora: a eugenia, ou a crença de que a reprodução seletiva pode ser usada para aprimorar a humanidade. De fato, algumas das vozes que demonstraram maior convicção de que esses métodos podem prever com sucesso características não patológicas fizeram afirmações surpreendentes sobre hierarquias genéticas naturais e diferenças raciais inatas.

No entanto, todos concordam que essa nova onda de tecnologia está ajudando a reacender um debate secular sobre natureza versus criação.

O termo “eugenia” foi cunhado em 1883 por um antropólogo e estatístico britânico chamado Sir Francis Galton, inspirado em parte pela obra de seu primo Charles Darwin. Ele o derivou de uma palavra grega que significa “de boa linhagem, hereditariamente dotado de qualidades nobres”.

Alguns dos capítulos mais sombrios da história moderna foram construídos sobre o legado de Galton, do Holocausto às leis de esterilização forçada que afetaram certos grupos nos Estados Unidos até o século XX. A ciência moderna demonstrou os muitos problemas lógicos e empíricos da metodologia de Galton. (Para começar, ele considerava conceitos vagos como “eminência” — bem como infecções como sífilis e tuberculose — como fenótipos hereditários, ou seja, características resultantes da interação entre genes e ambiente.)

Ainda hoje, a influência de Galton persiste no campo da genética comportamental, que investiga as raízes genéticas das características psicológicas. A partir da década de 1960, pesquisadores nos EUA começaram a revisitar um dos métodos prediletos de Galton: os estudos com gêmeos. Muitos desses estudos, que analisavam pares de gêmeos idênticos e fraternos para tentar determinar quais características eram hereditárias e quais resultavam da socialização, foram financiados pelo governo americano. O mais conhecido deles, o Estudo de Gêmeos de Minnesota, também recebeu verbas do Pioneer Fund, uma organização sem fins lucrativos, hoje extinta, que promovia a eugenia e o “aprimoramento racial” desde sua fundação em 1937.

O debate entre natureza e criação atingiu um ponto de inflexão importante em 2003, quando o Projeto Genoma Humano foi declarado concluído. Após 13 anos e a um custo de quase 3 bilhões de dólares, um consórcio internacional de milhares de pesquisadores sequenciou 92% do genoma humano pela primeira vez.

Hoje, o custo do sequenciamento de um genoma pode ser tão baixo quanto US$ 600, e uma empresa afirma que em breve cairá ainda mais. Essa redução drástica possibilitou a construção de enormes bancos de dados de DNA, como o UK Biobank e o All of Us dos Institutos Nacionais de Saúde (NIH), cada um contendo dados genéticos de mais de meio milhão de voluntários. Recursos como esses permitiram que pesquisadores realizassem estudos de associação genômica ampla (GWAS, na sigla em inglês), que identificam correlações entre variantes genéticas e características humanas por meio da análise de polimorfismos de nucleotídeo único (SNPs) — a forma mais comum de variação genética entre indivíduos. Os resultados desses estudos servem como ponto de referência para o desenvolvimento de escores de risco poligênico.

A maioria dos GWASs (estudos de associação genômica ampla) tem se concentrado na prevenção de doenças e na medicina personalizada. Mas, em 2011, um grupo de pesquisadores médicos, cientistas sociais e economistas lançou o Consórcio de Associação Genética em Ciências Sociais (SSGAC) para investigar a base genética de desfechos sociais e comportamentais complexos. Um dos fenótipos em que se concentraram foi o nível de escolaridade alcançado pelas pessoas.

“Foi um fenótipo um tanto conveniente”, explica Patrick Turley, economista e membro do comitê diretivo do SSGAC, visto que o nível de escolaridade é rotineiramente registrado em pesquisas quando dados genéticos são coletados. Ainda assim, “ficou claro que os genes desempenham algum papel”, afirma. “E tentar entender qual é esse papel, eu acho, é realmente interessante.” Ele acrescenta que os cientistas sociais também podem usar dados genéticos para tentar “entender melhor o papel que se deve a vias não genéticas”.

Muitos na esquerda geralmente estão dispostos a admitir que diversas características, desde o vício até a obesidade, são influenciadas geneticamente. No entanto, a capacidade cognitiva hereditária parece estar “fora de questão para nós, sendo considerada uma fonte de diferença”.

O trabalho imediatamente provocou sentimentos de desconforto — sobretudo entre os próprios membros do consórcio, que temiam poder, involuntariamente, reforçar o racismo, a desigualdade e o determinismo genético.

Isso também gerou bastante desconforto em alguns círculos políticos, afirma Kathryn Paige Harden, psicóloga e geneticista comportamental da Universidade do Texas em Austin, que diz ter passado grande parte de sua carreira defendendo o argumento impopular de que os genes são preditores relevantes de resultados sociais para seus colegas liberais.

Harden acredita que um ponto forte da esquerda é a capacidade de reconhecer “que os corpos são diferentes uns dos outros de uma forma que importa”. Muitos estão dispostos a admitir que diversas características, da dependência química à obesidade, são influenciadas geneticamente. No entanto, ela afirma que a capacidade cognitiva hereditária parece ser “algo inaceitável para nós, como uma fonte de diferença que impacta nossas vidas”.

Harden acredita que os genes são importantes para a nossa compreensão de características como a inteligência e que isso deve ajudar a moldar políticas públicas progressistas. Ela dá o exemplo de um departamento de educação que busca intervenções políticas para melhorar as notas de matemática em um determinado distrito escolar. Se uma pontuação de risco poligênico estiver “tão fortemente correlacionada com as notas escolares” quanto a renda familiar, diz ela sobre os alunos desse distrito, então “não coletar deliberadamente essa informação [genética], ou não saber sobre ela, torna a pesquisa mais difícil [e] as conclusões piores?”.

Para Harden, persistir nessa estratégia de evasão por medo de encorajar os eugenistas é um erro. Se “insistir que o QI é um mito e que os genes não têm nada a ver com ele fosse eficaz para neutralizar a eugenia”, diz ela, “já teria funcionado”.

Parte da razão pela qual essas ideias são tão tabu em muitos círculos é que o debate atual em torno do determinismo genético ainda está profundamente impregnado pelas ideias de Galton — e se tornou uma fixação particular entre a direita online.

Após Elon Musk assumir o controle do Twitter (agora X) em 2022 e afrouxar suas restrições ao discurso de ódio, uma enxurrada de contas começou a compartilhar publicações racistas , algumas especulando sobre as origens genéticas da desigualdade enquanto argumentavam contra a imigração e a integração racial. O próprio Musk frequentemente republica e interage com contas como Crémieux Recueil, pseudônimo do pesquisador independente Jordan Lasker, que escreveu sobre a “diferença de QI entre negros e brancos”, e i/o, uma conta anônima que certa vez elogiou Musk por “reconhecer dados sobre raça e crime”, dizendo que isso “fez mais para aumentar a conscientização sobre as desproporcionalidades observadas nesses dados do que qualquer outra coisa que eu me lembre”. (Em resposta às alegações de que sua pesquisa incentiva a eugenia, Lasker escreveu à MIT Technology Review : “O entendimento popular de eugenia se refere à coerção e à exclusão de pessoas consideradas ‘indesejáveis’ do grupo reprodutivo. Isso não tem nada a ver com isso, portanto, não se qualifica como eugenia segundo esse entendimento popular do termo.” Após a publicação, o i/o escreveu em um e-mail: “Só porque as diferenças de inteligência em nível individual são em grande parte hereditárias, não significa que as diferenças de grupo na inteligência medida… sejam devidas a diferenças genéticas entre os grupos”, mas que esta última questão não é “cientificamente comprovada” e é “uma área de pesquisa extremamente importante (e necessária) que deve ser financiada em vez de se tornar tabu”. Ele acrescentou: “Nunca argumentei contra a integração racial, o casamento inter-racial ou qualquer coisa do tipo.” X e Musk não responderam aos pedidos de comentários.)

Harden, no entanto, alerta para o perigo de desconsiderar o trabalho de toda uma área de pesquisa por causa de alguns neorreacionários barulhentos. “Acho que pode existir essa ideia de que a tecnologia está dando origem ao racismo terrível”, diz ela. A verdade, acredita ela, é que “o racismo já existia antes de qualquer tecnologia”.

Em 2019, uma empresa chamada Genomic Prediction começou a oferecer o primeiro teste poligênico pré-implantacional comercialmente disponível. Com o LifeView Embryo Health Score, os futuros pais podem avaliar a predisposição de seus embriões a problemas de saúde geneticamente complexos, como câncer, diabetes e doenças cardíacas. O preço do serviço começa em US$ 3.500. A Genomic Prediction utiliza uma técnica chamada microarray de SNPs, que identifica locais específicos no genoma onde ocorrem variantes comuns. Os resultados são então comparados com GWASs (estudos de associação genômica ampla) que mostram correlações entre variantes genéticas e determinadas doenças.

Quatro anos depois, uma empresa chamada Orchid começou a oferecer um teste concorrente. O Relatório de Genoma Completo do Embrião da Orchid se destacou por alegar sequenciar mais de 99% do genoma de um embrião, permitindo detectar novas mutações e, segundo a empresa, diagnosticar doenças raras com mais precisão. Por US$ 2.500 por embrião, os pais podem acessar pontuações de risco poligênico para 12 distúrbios, incluindo esquizofrenia, câncer de mama e hipotireoidismo.

A Orchid foi fundada por uma mulher chamada Noor Siddiqui. Antes de obter seus diplomas de graduação e pós-graduação em Stanford, ela recebeu a bolsa Thiel — uma bolsa de US$ 200.000 concedida a jovens empreendedores dispostos a trabalhar em suas ideias em vez de frequentar a faculdade — quando ainda era adolescente, em 2012. Isso a preparou para atrair a atenção de membros da elite tecnológica, tanto como clientes quanto como investidores. Sua empresa já arrecadou US$ 16,5 milhões de investidores como Vitalik Buterin, fundador do Ethereum, Balaji Srinivasan, ex-CTO da Coinbase, e Armstrong, CEO da Coinbase.

Em agosto, Siddiqui fez a sugestão controversa de que os pais que optam por não fazer testes genéticos podem ser considerados irresponsáveis. “Sejam honestos: vocês estão bem com o potencial sofrimento do seu filho pelo resto da vida só para se sentirem moralmente superiores…”, escreveu ela no X.

Os americanos têm opiniões diversas sobre a tecnologia emergente. Em 2024, um grupo de bioeticistas entrevistou 1.627 adultos nos EUA para determinar suas atitudes em relação a uma variedade de critérios de testes poligênicos. Uma grande maioria aprovou os testes para condições de saúde física como câncer, doenças cardíacas e diabetes. A triagem para transtornos de saúde mental, como depressão, TOC e TDAH, obteve uma resposta mais mista, mas ainda positiva. Características relacionadas à aparência, como cor da pele, calvície e altura, receberam menos aprovação como algo para o qual se deva realizar testes.

A inteligência foi uma das características mais controversas — o que não surpreende, dada a forma como foi instrumentalizada ao longo da história e a falta de consenso cultural sobre como deveria ser definida. (Em muitos países, os testes de inteligência em embriões são fortemente regulamentados; no Reino Unido, a prática é totalmente proibida.) Na pesquisa de 2024, 36,9% dos entrevistados aprovaram o teste genético pré-implantacional para inteligência, 40,5% desaprovaram e 22,6% disseram estar indecisos.

Apesar da divergência, a inteligência tem sido uma das características mais discutidas como alvo de testes. Desde o início, a Genomic Prediction afirma ter recebido consultas “do mundo todo” sobre testes de inteligência, segundo Diego Marin, chefe de desenvolvimento de negócios globais e assuntos científicos da empresa.

Em determinado momento, a empresa ofereceu um preditor para o que chamava de “deficiência intelectual”. Após algumas críticas questionando tanto a capacidade preditiva quanto a ética dessas pontuações, a empresa descontinuou o recurso. “Nossa missão e visão para esta empresa não é melhorar [um bebê], mas reduzir o risco de doenças”, disse Marin. “Quando se trata de características como QI, cor da pele, altura ou algo que seja puramente estético e não tenha nenhuma relação com uma doença, simplesmente não investimos nisso.”

A Orchid, por outro lado, realiza testes para marcadores genéticos associados à deficiência intelectual e ao atraso no desenvolvimento. Mas isso pode não ser tudo. De acordo com um funcionário da empresa, que falou sob condição de anonimato, testes de inteligência também são oferecidos a clientes de alto poder aquisitivo. Segundo esse funcionário, outra fonte próxima à empresa e reportagem do Washington Post, Musk utilizou os serviços da Orchid na concepção de pelo menos um dos filhos que tem com a executiva de tecnologia Shivon Zilis. (A Orchid, Musk e Zilis não responderam aos pedidos de comentários.)

Conheci Kian Sadeghi, o fundador de 25 anos da Nucleus Genomics, com sede em Nova York, em uma tarde escaldante de julho em seu escritório no SoHo. Magro e enérgico, Sadeghi falava em ritmo acelerado, parando apenas ocasionalmente para perguntar se eu estava acompanhando.

Sadeghi modificou seu primeiro organismo — uma amostra de levedura de cerveja — aos 16 anos. Em 2016, enquanto cursava o ensino médio, fez um curso sobre CRISPR-Cas9 em um laboratório no Brooklyn e se apaixonou pela “bela profundidade” da genética. Poucos anos depois, abandonou a faculdade para construir “um 23andMe melhor”.

Sua empresa tem como alvo o que você poderia chamar de camada de aplicação do PGT-P, aceitando dados de clínicas de fertilização in vitro — e até mesmo dos concorrentes mencionados nesta matéria — e executando sua própria análise computacional.

“Ao contrário de muitas outras empresas de testes, priorizamos o software e o consumidor”, disse Sadeghi. “Não basta atribuir uma pontuação poligênica a alguém. O que isso significa? Como compará-las? Há muitos problemas de design realmente complexos envolvidos.”

Assim como seus concorrentes, o Nucleus calcula seus escores de risco poligênico comparando os dados genéticos de um indivíduo com variantes associadas a características identificadas em grandes estudos de associação genômica ampla (GWAS), fornecendo previsões estatisticamente embasadas.

O Nucleus fornece duas visualizações dos resultados de um paciente: um escore Z, plotado de -4 a 4, que explica o risco de uma determinada característica em relação a uma população com ancestralidade genética semelhante (por exemplo, se o Embrião nº 3 tiver um escore Z de 2,1 para câncer de mama, seu risco é maior que a média), e um escore de risco absoluto, que inclui fatores clínicos relevantes (o Embrião nº 3 tem um risco real mínimo de câncer de mama, visto que é do sexo masculino).

A verdadeira diferença entre a Nucleus e seus concorrentes reside na abrangência do que ela afirma oferecer aos clientes. Em seu site moderno, os futuros pais podem filtrar entre mais de 2.000 possíveis doenças, bem como características que vão da cor dos olhos ao QI. O acesso à plataforma Nucleus Embryo custa US$ 8.999, enquanto a nova oferta IVF+ da empresa — que inclui um ciclo de fertilização in vitro (FIV) com uma clínica parceira, triagem de até 20 embriões e serviços de acompanhamento personalizado durante todo o processo — tem preço inicial de US$ 24.999.

“Talvez você queira que seu bebê tenha olhos azuis em vez de olhos verdes”, disse Kian Sadeghi, fundador da Nucleus, em um evento em junho. “Isso fica a critério dos pais.”

Suas promessas são notavelmente ousadas. A empresa afirma ser capaz de prever a propensão a ansiedade, TDAH, insônia e outros problemas mentais. Diz que você pode ver quais de seus embriões têm maior probabilidade de desenvolver dependência de álcool, quais têm maior probabilidade de serem canhotos e quais podem acabar com acne grave ou alergias sazonais. (No entanto, no momento da redação deste texto, a plataforma de triagem de embriões forneceu a seguinte ressalva: “O DNA não é o destino. A genética pode ser uma ferramenta útil para escolher um embrião, mas não é uma garantia. A pesquisa genética ainda está em seus primórdios e ainda há muito que não sabemos sobre como o DNA molda quem somos.”)

Para quem está acostumado com aplicativos de monitoramento do sono, suplementos de biohacking e monitoramento de glicose, aproveitar as opções oferecidas pela Nucleus pode parecer óbvio. Já para quem aprecia um pouco de acaso na vida, esse nível de controle percebido pode ser, no mínimo, desconcertante.

Sadeghi gosta de enquadrar seus argumentos em termos de escolha pessoal. “Talvez você queira que seu bebê tenha olhos azuis em vez de olhos verdes”, disse ele a um pequeno público no evento de lançamento da Nucleus Embryo em junho. “Isso é uma decisão que cabe aos pais.”

No dia do lançamento oficial, Sadeghi passou horas debatendo alegremente com usuários do X que o acusavam de praticar eugenia. Ele rejeita o termo, preferindo “otimização genética” — embora pareça não ter se incomodado muito com o marketing viral gratuito. “Esta semana, tivemos cinco milhões de impressões no Twitter”, disse ele a uma plateia no evento de lançamento, sob alguns aplausos. (Em um e-mail para a MIT Technology Review, Sadeghi escreveu: “A história da eugenia é uma história de coerção e discriminação por estados e instituições; o que o Nucleus faz é o oposto — previsão genética que capacita os indivíduos a tomar decisões informadas.”)

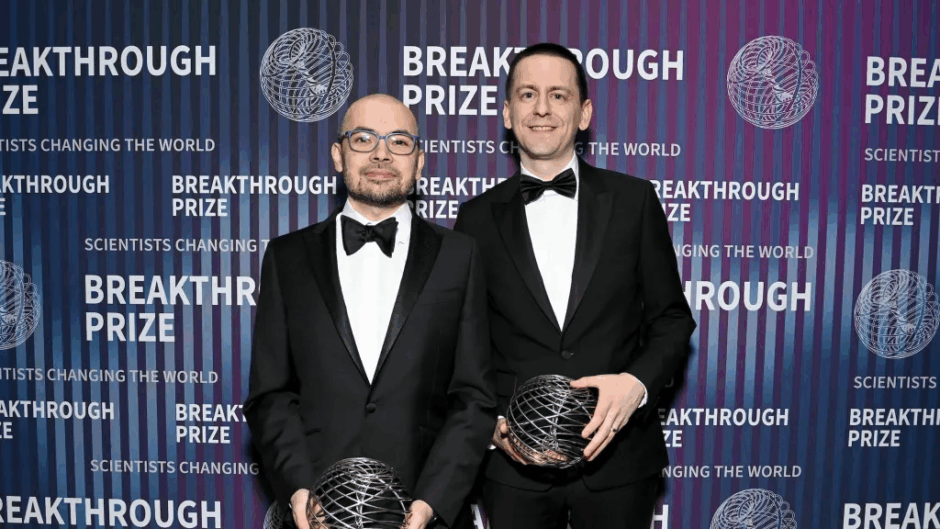

A Nucleus arrecadou mais de US$ 36 milhões de investidores como Srinivasan, a empresa de capital de risco de Alexis Ohanian, Seven Seven Six, e o Founders Fund de Thiel. (Assim como Siddiqui, Sadeghi recebeu uma bolsa de estudos de Thiel quando abandonou a faculdade; um representante de Thiel não respondeu a um pedido de comentário para esta matéria.) Sadeghi chegou a contratar Nathan Treff, cofundador da Genomic Prediction, que agora é o diretor clínico da Nucleus.

O verdadeiro objetivo de Sadeghi é construir uma plataforma completa para todas as aplicações possíveis da tecnologia de sequenciamento genético, da genealogia à medicina de precisão e à engenharia genética. Ele cita algumas empresas que fornecem esses serviços, com um valor de mercado combinado na casa dos bilhões. “A Nucleus está reunindo todas essas cinco empresas em uma só”, afirma. “Não somos uma empresa de testes de fertilização in vitro. Somos uma plataforma genética completa.”

Nesta primavera, abri caminho a cotoveladas até um bar de hotel lotado no bairro Flatiron, onde mais de cem pessoas se reuniram para ouvir uma palestra intitulada “Como criar SUPERBEBÊS”. O evento fazia parte da Semana de Tecnologia Avançada de Nova York, então eu esperava encontrar alguns profissionais e investidores da área de biotecnologia. Em vez disso, fiquei surpresa ao me deparar com um grupo diversificado e curioso de criativos, engenheiros de software, estudantes e futuros pais — muitos dos quais não tinham nenhum conhecimento prévio sobre o assunto.

O palestrante daquela noite foi Jonathan Anomaly, um filósofo político de voz suave, cujo tom didático denuncia seus anos como professor universitário.

Parte do trabalho acadêmico de Anomaly tem se concentrado no desenvolvimento de teorias do comportamento racional. Na Universidade Duke e na Universidade da Pensilvânia, ele ministrou cursos introdutórios sobre teoria dos jogos, ética e problemas de ação coletiva, bem como bioética, aprofundando-se em questões complexas sobre aborto, vacinas e eutanásia. Mas talvez nenhum tópico o tenha interessado tanto quanto o campo emergente do aprimoramento genético.

Em 2018, em um periódico de bioética, Anomaly publicou um artigo com o título intencionalmente provocativo “Defendendo a Eugenia”. Ele procurou distinguir o que chamou de “eugenia positiva” — métodos não coercitivos que visam aumentar características que “promovem o bem-estar individual e social” — da chamada “eugenia negativa” que conhecemos dos nossos livros de história.

Anomaly gosta de argumentar que a seleção de embriões não é tão diferente de práticas que já consideramos normais. Não acredita que dois primos devam ter filhos? Talvez você seja um eugenista, ele afirma. Seu amigo que escolheu um graduado de Harvard de 1,88m em uma pasta com potenciais doadores de esperma? A lógica é a mesma.

Sua contratação pela Universidade da Pensilvânia em 2019 causou indignação entre alguns estudantes, que o acusaram de “essencialismo racial”. Em 2020, Anomaly deixou a vida acadêmica, lamentando que “as universidades americanas tivessem se tornado uma prisão intelectual”.

Alguns anos depois, a Anomaly juntou-se a uma empresa PGT-P nascente chamada Herasight, que prometia realizar testes de QI.

No final de julho, a empresa saiu oficialmente do modo stealth. Um representante me disse que a maior parte do dinheiro arrecadado até agora vem de investidores-anjo, incluindo Srinivasan, que também investiu na Orchid e na Nucleus. De acordo com o anúncio de lançamento na X, a Herasight analisou “centenas de embriões” para clientes particulares e está começando a oferecer seu primeiro produto para o consumidor final, uma avaliação poligênica que afirma detectar a probabilidade de um embrião desenvolver 17 doenças.

Seus materiais de marketing alardeiam capacidades preditivas 122% melhores que as da Orchid e 193% melhores que as da Genomic Prediction para esse conjunto de doenças. (“A Herasight está comparando seu preditor atual com modelos que publicamos há mais de cinco anos”, respondeu a Genomic Prediction em um comunicado. “Nossa equipe está confiante de que nossos preditores são de classe mundial e não são superados em qualidade por nenhum outro laboratório.”)

A empresa não incluiu comparações com a Nucleus, apontando para a “ausência de validações de desempenho publicadas” por essa empresa e alegando que se tratava de um caso em que “o marketing supera a ciência”. (“A Nucleus é conhecida por sua ciência e marketing de classe mundial, e entendemos por que isso é frustrante para nossos concorrentes”, respondeu um representante da empresa em um comentário.)

A Herasight também enfatizou os novos avanços na “validação intrafamiliar” (garantindo que as pontuações não estejam apenas captando fatores ambientais compartilhados, comparando o desempenho entre pessoas não relacionadas com o desempenho entre irmãos) e na “precisão entre ancestralidades diferentes” (aprimorando a precisão das pontuações para pessoas fora dos grupos de ancestralidade europeia, onde se concentra a maior parte dos dados do biobanco). O representante explicou que os preços variam de acordo com o cliente e o número de embriões testados, mas podem chegar a US$ 50.000.

Quando se trata de características que Jonathan Anomaly acredita serem geneticamente codificadas, a inteligência é apenas a ponta do iceberg. Ele também já falou sobre a hereditariedade da empatia, da violência, da religiosidade e das inclinações políticas.

O teste Herasight avalia apenas uma característica não relacionada a doenças: a inteligência. Para um casal que produz 10 embriões, afirma ser capaz de detectar uma variação de QI de cerca de 15 pontos, do embrião com a pontuação mais baixa ao de maior QI. O representante da empresa afirma que a empresa planeja publicar um relatório técnico detalhado sobre seu preditor de QI futuramente.

No dia do lançamento da Herasight, Musk respondeu ao anúncio da empresa: “Legal”. Enquanto isso, um pesquisador dinamarquês chamado Emil Kirkegaard, cuja pesquisa se concentra principalmente nas diferenças de QI entre grupos raciais, divulgou a empresa para seus quase 45.000 seguidores no X (bem como em um blog no Substack), escrevendo: “A seleção adequada de embriões acaba de chegar”. Kirkegaard, na verdade, apoia o trabalho da Anomaly há anos; ele já publicou sobre ela no X e recomendou seu livro de 2020, ” Creating Future People”, que ele chamou de “um livro de defesa da eugenia biotecnológica”, acrescentando: “Naturalmente, concordo com isso!”.

Quando se trata de características que Anomaly acredita serem geneticamente codificadas, a inteligência — que ele afirmou em sua palestra ser cerca de 75% hereditária — é apenas a ponta do iceberg. Ele também falou sobre a hereditariedade da empatia, do controle dos impulsos, da violência, da passividade, da religiosidade e das inclinações políticas.

Anomaly reconhece que existem limitações quanto aos tipos de previsões relativas que podem ser feitas a partir de um pequeno lote de embriões. Mas ele acredita que estamos apenas no início do que ele gosta de chamar de “revolução reprodutiva”. Em sua palestra, ele mencionou uma tecnologia atualmente em desenvolvimento em algumas startups: a gametogênese in vitro (GIV). A GIV visa criar espermatozoides ou óvulos em laboratório usando células-tronco adultas, geneticamente reprogramadas a partir de células encontradas em uma amostra de pele ou sangue. Em teoria, esse processo poderia permitir que um casal produzisse rapidamente um número praticamente ilimitado de embriões para analisar as características desejadas. Anomaly previu que essa tecnologia poderia estar pronta para uso em humanos dentro de oito anos.

“Duvido que a FDA permita isso imediatamente. É para isso que existem lugares como Próspera”, disse ele, referindo-se à chamada “cidade das startups” em Honduras, onde cientistas e empreendedores podem realizar experimentos médicos livres dos tipos de supervisão regulatória que encontrariam nos EUA.

“Você pode ter uma intuição moral de que isso está errado”, disse Anomaly, “mas quando se descobre que as elites estão fazendo isso em segredo… o efeito dominó vai acontecer muito, muito rapidamente.” A vindoura “corrida armamentista evolutiva”, afirmou ele, “mudará o panorama moral”.

Ele acrescentou que alguns desses membros da elite são seus próprios clientes: “Eu já poderia citar nomes, mas não vou fazê-lo.”

Após a palestra de Anomaly, conversei com um jovem fotógrafo que me disse que esperava fazer um mestrado em teologia. Ele veio ao evento, contou-me, para refletir sobre as implicações éticas de brincar de Deus. “A tecnologia está nos conduzindo a um momento de transição entre o Antigo e o Novo Testamento, em que precisamos decidir quais partes da religião ainda nos servem”, disse ele, com seriedade.

As críticas aos testes poligênicos tendem a se dividir em duas vertentes: ceticismo quanto à eficácia dos testes e preocupações com a ética envolvida. “Por um lado”, diz Turley, do Consórcio de Associações de Genética em Ciências Sociais, “há quem argumente: ‘Isso não vai funcionar de qualquer forma, e o problema é que estamos enganando os pais’. Por outro lado, há quem diga: ‘Ah, isso vai funcionar tão bem que vai levar a enormes desigualdades na sociedade’. É até engraçado ver isso. Às vezes, esses argumentos são feitos pelas mesmas pessoas.”

Uma dessas pessoas é Sasha Gusev, que dirige um laboratório de genética quantitativa no Instituto de Câncer Dana-Farber. Crítico ferrenho do PGT-P para seleção de embriões, ele também participa frequentemente de debates online com perfis de extrema-direita que promovem a ciência racial no X.

Gusev é um dos muitos profissionais em sua área que acreditam que, devido a inúmeros fatores socioeconômicos que podem gerar confusão — por exemplo, nutrição infantil, geografia, redes pessoais e estilos parentais — não faz muito sentido tentar rastrear resultados como o nível de escolaridade até a genética, principalmente não como forma de provar que existe uma base genética para o QI.

Ele acrescenta: “Acho que existe um risco real em caminhar para uma sociedade onde a genética e as ‘dotações genéticas’ são vistas como os fatores determinantes do comportamento das pessoas e como um limite para seus resultados e suas capacidades.”

Gusev acredita que essa tecnologia tem um potencial real em ambientes clínicos, principalmente em populações adultas específicas. Para adultos identificados com altos escores de risco poligênico para câncer e doenças cardiovasculares, ele argumenta que uma combinação de triagem precoce e intervenção pode salvar vidas. No entanto, quando se trata dos testes pré-implante atualmente disponíveis no mercado, ele considera que existem limitações significativas — e poucas medidas regulatórias ou métodos de validação a longo prazo para verificar as promessas feitas pelas empresas. Ele teme que dar muita atenção a esses serviços possa ser contraproducente.

“Essas aplicações imprudentes, com promessas exageradas e, muitas vezes, puramente manipuladoras, na seleção de embriões representam um risco para a credibilidade e a utilidade dessas ferramentas clínicas”, afirma ele.

Muitos pacientes de fertilização in vitro também tiveram reações fortes à publicidade em torno do PGT-P. Quando o New York Times publicou um artigo de opinião sobre a Orchid na primavera, pais furiosos recorreram ao Reddit para expressar sua indignação. Um usuário postou: “Para quem não sabe por que outros tipos de testes são necessários, isso só faz parecer que as pessoas que fazem fertilização in vitro querem criar bebês ‘perfeitos’, quando nós só queremos bebês saudáveis.”

Ainda assim, outros defenderam a necessidade de uma conversa. “Quando tecnologias como essa poderiam mudar a missão de ajudar pessoas inférteis a terem bebês saudáveis para a eugenia?”, questionou um usuário do Reddit. “É uma linha tênue e uma discussão importante a ser feita.”

Alguns defensores do PGT-P, como Kirkegaard e Anomaly, argumentam que as decisões políticas devem levar em conta, de forma mais explícita, as diferenças genéticas. Em uma série de posts em seu blog após a eleição presidencial de 2024, sob o título “Tornar a ciência grandiosa novamente”, Kirkegaard defendeu o fim das leis de ação afirmativa, a legalização da discriminação racial na contratação e a remoção de restrições a conjuntos de dados como o biobanco All of Us do NIH, que impedem pesquisadores como ele de usar os dados para pesquisas sobre raça. Anomaly criticou as políticas de bem-estar social por manipularem a balança para “punir pessoas com QI elevado”.

De fato, a noção de determinismo genético ganhou certa força entre os apoiadores do presidente Donald Trump.

Em outubro de 2024, o próprio Trump fez uma parada de campanha no programa de rádio conservador The Hugh Hewitt Show. Ele começou uma resposta confusa sobre imigração e estatísticas de homicídios. “Um assassino, eu acredito nisso, está nos genes deles. E nós temos muitos genes ruins em nosso país agora”, disse ele ao apresentador.

Gusev acredita que, embora a seleção de embriões não tenha grande impacto nos resultados individuais, a estrutura intelectual defendida por muitos proponentes do PGT-P pode ter consequências sociais graves.

“Se você considerar as diferenças que observamos na sociedade apenas como culturais, então você ajuda as pessoas. Você lhes proporciona melhor escolaridade, melhor nutrição e educação, e elas conseguem se destacar”, diz ele. “Se você considerar essas diferenças como fortemente inatas, pode se iludir pensando que nada pode ser feito e que as pessoas simplesmente nascem como são.”

Por enquanto, não há planos para estudos longitudinais que acompanhem os resultados reais dos seres humanos que essas empresas ajudaram a trazer ao mundo. Harden, o geneticista comportamental da Universidade do Texas em Austin, suspeita que, daqui a 25 anos, os adultos que um dia foram embriões selecionados com base em pontuações de risco poligênico “acabarão com a mesma pergunta que todos nós temos”. Eles olharão para suas vidas e se perguntarão: “O que teria que ter mudado para que fosse diferente?”